Stel je voor: je wordt wakker, pakt je telefoon van het nachtkastje, en nog voordat je iets hebt getypt, staat je agenda klaar met een aangepaste route naar kantoor — er is een ongeluk op de A2, je vertrekt beter tien minuten eerder. Je koffiezetapparaat begint al te pruttelen omdat je smartwatch merkte dat je in beweging kwam. En die e-mail van je baas? Je telefoon heeft de kern al samengevat: geen actie nodig, kan wachten tot na de lunch. Niemand heeft je iets gevraagd. Je apparaten wisten het gewoon.

Welkom in 2026, het jaar waarin kunstmatige intelligentie niet langer iets is dat ergens in een datacenter draait, maar stilletjes in je broekzak leeft.

Wat is on-device AI eigenlijk?

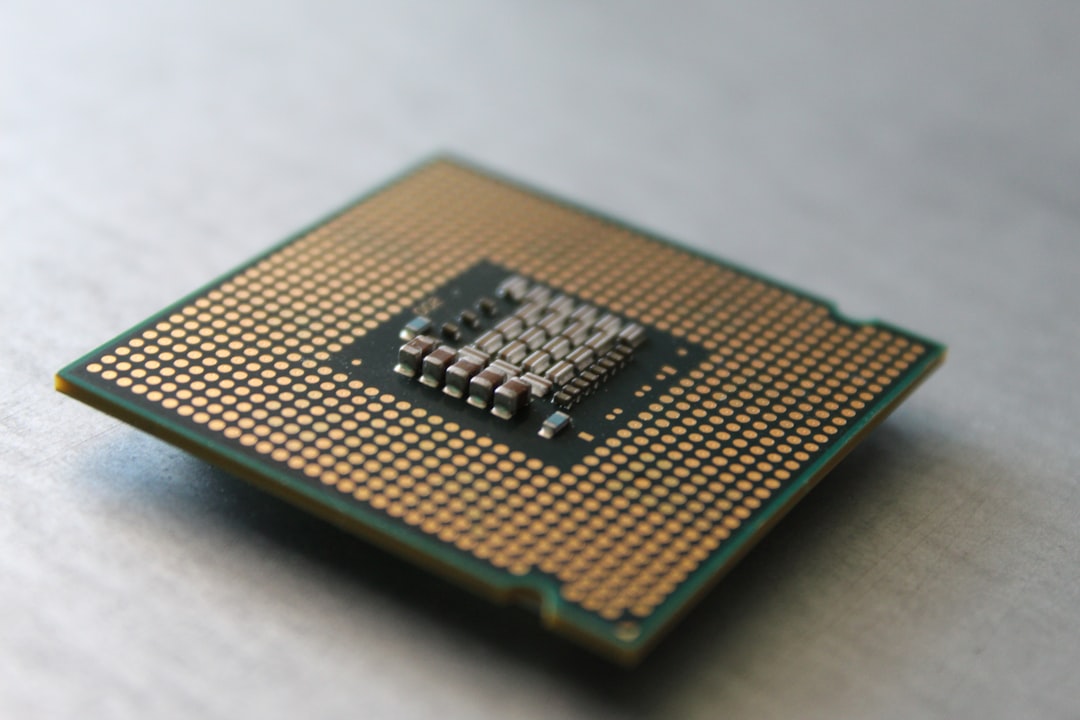

De term klinkt technisch, maar het concept is verrassend eenvoudig. On-device AI betekent dat de slimme functies van je telefoon, tablet of smartwatch niet meer afhankelijk zijn van een internetverbinding en een server ergens in Amerika. In plaats daarvan zit er een speciale chip in je apparaat — een zogeheten Neural Processing Unit, of NPU — die het denkwerk lokaal doet.

Dat is een fundamentele verschuiving. Tot voor kort stuurde je telefoon elke spraakcommando, elke foto die je wilde bewerken en elke zoekopdracht naar de cloud. Daar werd het verwerkt door enorme computers, en het resultaat werd teruggestuurd. Snel genoeg voor de meeste taken, maar met een prijs: je data reisde de wereld over, en zonder wifi was je slimme assistent plotseling niet zo slim meer.

De chip die alles veranderde

De grote techbedrijven hebben de afgelopen twee jaar een stille wapenwedloop gevoerd. Apple's A19 Bionic, Qualcomm's Snapdragon 8 Gen 4 en Google's Tensor G5 bevatten allemaal krachtige NPU's die speciaal zijn ontworpen voor AI-taken. Deze chips kunnen miljarden berekeningen per seconde uitvoeren — niet voor games of video, maar specifiek voor het herkennen van patronen, het begrijpen van taal en het voorspellen van je volgende stap.

Het resultaat merk je dagelijks. Foto's bewerken gaat razendsnel: de AI herkent gezichten, verwijdert ongewenste objecten en past belichting aan in fracties van een seconde. Vertalen gebeurt real-time tijdens telefoongesprekken, inclusief de juiste intonatie en pauzes. En spraakherkenning werkt nu feilloos, zelfs in een drukke kroeg — iets wat twee jaar geleden nog ondenkbaar was.

Maar de echte doorbraak zit in de subtielere functies. Je telefoon leert wanneer je het druk hebt en dempt meldingen automatisch. Hij weet dat je op maandagochtend altijd dezelfde podcast luistert en start die alvast. Hij merkt dat je al twee weken dagelijks recepten voor pasta zoekt en stelt voor om een boodschappenlijst te maken.

Privacy: eindelijk een belofte die wordt waargemaakt?

Hier wordt het interessant — en voor veel Nederlanders ook relevant. We zijn een volk dat privacy serieus neemt. De AVG (GDPR) is hier geboren, en het wantrouwen tegenover big tech en dataverzameling zit diep.

On-device AI raakt precies die zenuw. Als je foto's, berichten en gewoontes lokaal worden verwerkt — op je eigen apparaat, zonder dat er iets naar een server wordt gestuurd — dan verdwijnt een groot deel van de privacyzorg. Je biometrische data, je locatiegeschiedenis, je gezondheidsgegevens: het blijft allemaal op de chip in je hand.

Tenminste, dat is de belofte. In de praktijk is het genuanceerder. Sommige functies hebben wél een cloudverbinding nodig, en de grens tussen wat lokaal en wat online wordt verwerkt is niet altijd transparant. De vraag die je jezelf moet stellen: als je telefoon je zo goed kent, wie heeft er dan nog meer toegang tot die kennis?

Fabrikanten claimen dat het antwoord 'niemand' is. Maar de techgeschiedenis leert ons dat beloftes over privacy een houdbaarheidsdatum hebben.

Wanneer 'handig' ongemakkelijk wordt

Er is een dunne lijn tussen een apparaat dat je helpt en een apparaat dat je doorziet. En die lijn schuift op.

Neem predictieve suggesties. Je telefoon weet dat je elke vrijdagavond pizza bestelt en opent alvast de bezorgapp. Handig? Zeker. Maar datzelfde systeem merkt ook op dat je de laatste tijd vaker zoekt naar 'stress verminderen' en 'slaapproblemen'. Het stelt voor om een meditatie-app te downloaden. Is dat zorgzaam of opdringerig?

Psychologen en technologie-ethici waarschuwen voor wat ze het 'personalisatieparadox' noemen: hoe beter technologie je begrijpt, hoe minder je wordt verrast, uitgedaagd of geconfronteerd met andere perspectieven. Je telefoon wordt een spiegel die alleen laat zien wat je wilt zien. Comfortabel, maar ook beperkend.

Voor jongere generaties, die opgroeien met apparaten die vanaf dag één hun voorkeuren leren, is dit misschien de normaalste zaak van de wereld. Voor iedereen die zich nog een tijd herinnert zonder smartphones: het voelt als een langzame verschuiving waar we collectief niet over hebben nagedacht.

Physical AI: als apparaten de echte wereld gaan begrijpen

De volgende stap is al gaande. Op CES 2026 — de grootste technologiebeurs ter wereld — was 'Physical AI' hét buzzword. Het idee: kunstmatige intelligentie die niet alleen tekst en beeld begrijpt, maar ook de fysieke wereld om je heen.

Concreet betekent dit dat je robotstofzuiger niet meer dom tegen meubels botst, maar de indeling van je huis echt snapt. Je slimme deurbel herkent niet alleen gezichten, maar begrijpt ook lichaamstaal — is die persoon aan de deur een bezorger of iemand die rondsluipt? Je auto leert jouw rijstijl en past de remkracht en stuurrespons daarop aan.

De koelkast die boodschappen doet klinkt als een grap uit 2015 die nooit werkelijkheid werd. Maar in 2026 zijn er modellen die daadwerkelijk herkennen wat erin zit, bijhouden wat je verbruikt en een boodschappenlijst samenstellen. Geen camera die je moet activeren — gewoon een apparaat dat meekijkt en meedenkt.

De vraag is niet meer óf onze apparaten de wereld om ons heen gaan begrijpen. De vraag is hoeveel controle we daarover houden.

Wat betekent dit voor hoe je technologie kiest?

Hier verschuift iets fundamenteels in de markt. Tot nu toe kocht je een telefoon op basis van camera-megapixels, schermgrootte en accuduur. Dat zijn nog steeds relevante specificaties, maar in 2026 komt er een nieuwe dimensie bij: hoe slim is het apparaat zelf?

De NPU wordt net zo belangrijk als de processor. De hoeveelheid AI-modellen die een telefoon lokaal kan draaien, bepaalt hoe goed hij functioneert als persoonlijke assistent. En dat vereist niet alleen rekenkracht, maar ook opslagruimte — die AI-modellen nemen gigabytes in beslag.

Voor de bewuste consument betekent dit: let niet alleen op wat een apparaat nu kan, maar op hoe goed het leert. Een telefoon met een sterke NPU en voldoende opslag wordt over twee jaar béter in plaats van slechter — omdat de AI-modellen blijven leren en verbeteren. Dat is een radicaal ander aankoopargument dan we gewend zijn.

En het geldt niet alleen voor telefoons. Tablets, smartwatches, oordopjes, en zelfs huishoudelijke apparaten: overal waar een chip zit, zit straks een stukje intelligentie.

De Nederlandse adoptie: nuchter maar nieuwsgierig

Nederlanders staan bekend om hun nuchtere houding tegenover technologie. We zijn geen early adopters in de VS-stijl die om drie uur 's nachts in de rij staan voor het nieuwste apparaat. Maar we zijn wél pragmatisch: als iets werkt en ons leven makkelijker maakt, omarmen we het snel.

De verwachting is dat on-device AI in Nederland vooral via praktische toepassingen zal doorbreken. Denk aan real-time vertaling voor de 2,5 miljoen Nederlanders die dagelijks in een meertalige omgeving werken. Of slimme gezondheidsfuncties die hartritme en slaapkwaliteit monitoren zonder dat die data naar een Amerikaans bedrijf wordt gestuurd.

Wat wél een obstakel vormt: de Nederlandse taal. Veel AI-modellen zijn getraind op Engelstalige data, en hoewel de ondersteuning voor Nederlands snel verbetert, merken gebruikers nog steeds dat hun assistent beter Engels dan Nederlands spreekt. Dat gaat veranderen — maar het feit dat het in 2026 nog een punt is, laat zien dat de AI-revolutie niet overal even snel gaat.

Wie bepaalt wat je apparaat over je weet?

Als we eerlijk zijn, hebben de meeste mensen geen idee wat hun telefoon allemaal over hen weet. Niet omdat het wordt verborgen, maar omdat niemand de tijd neemt om het na te kijken. De instellingenmenu's zijn labyrinten van toggles en toestemmingen die bewust verwarrend zijn ontworpen.

En dat is misschien wel het grootste risico van on-device AI. Het is niet de technologie zelf die problematisch is — lokale verwerking is objectief beter voor je privacy dan cloudverwerking. Het risico zit in de asymmetrie van kennis: je apparaat weet steeds meer over jou, maar jij weet steeds minder over je apparaat.

De techbedrijven die dit het beste oplossen — door transparantie, echte controle en begrijpelijke uitleg — zullen het vertrouwen van consumenten winnen. De bedrijven die het niet doen, lopen het risico dat de terugslag net zo hard komt als bij de social media-backlash van de afgelopen jaren.

We staan op een kantelpunt. De technologie in onze zakken wordt niet alleen sneller of mooier — ze wordt bewust. Ze leert, onthoudt en anticipeert. De vraag is niet of je daaraan mee wilt doen; je doet het al. De vraag is of je er bewust mee omgaat. Of je weet wat je weggeeft, wat je terugkrijgt, en of die ruil het waard is. Want je telefoon heeft die afweging allang voor je gemaakt.